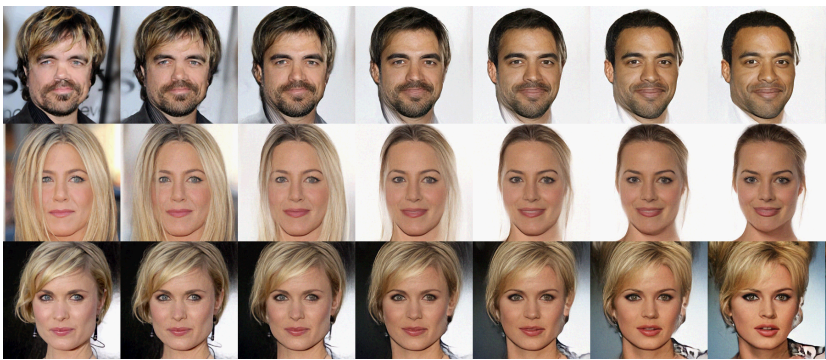

生成模型一直以来让人沉醉,不仅因为支持许多有意思的应用落地,而且模型超预期的创造力总是让许多学者和厂商得以“秀肌肉”:

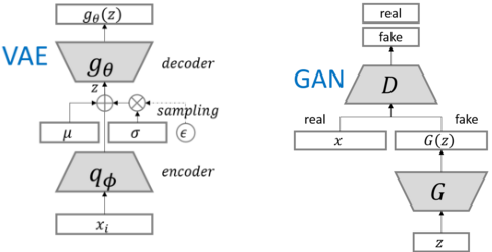

了解基于流的生成模型(flow-based)前,先回顾目前主流的两类生成模型GAN和VAE,David 9文章早已介绍过:

GAN简单粗暴,用两个深度网络(判别器D和生成器G)交替学习使得生成器G可以模拟现实生成样本,但是缺陷也是明显的:GAN不能直接了当地给出一个样本的隐分布的表征(你可以生成一个明星,但是你无法马上生成一个“微笑的”或“年轻的”明星),即,你很难用隐变量随意操纵生成的样本,你只知道生成的是任意样本(除非你重新设计GAN,像我们以前谈到的cGAN或者FaderNetworks等等。。)

VAE思路就完全不同,它继承了古老的贝叶斯理论,相信一切的创造可以用抽样后验概率来缔造。

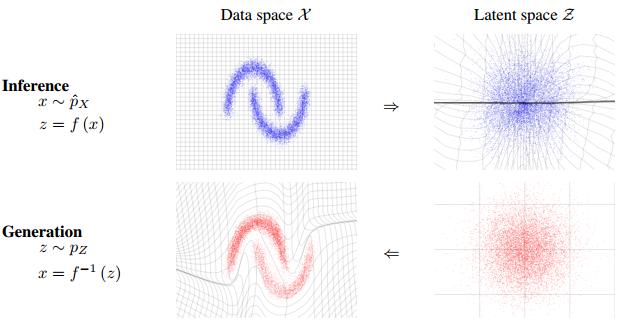

你想创造新样本?好的,但是真实分布空间X 太复杂了,我们先意淫一个后验空间Z吧:

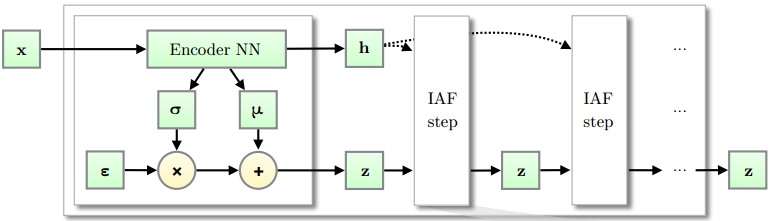

只要X空间和Z空间是可以相互映射转换,从一个简单Z空间中抽样随机变量z,就能从z生成在X空间中的真实样本x 。注意:VAE不仅是encoder和decoder的简单组合,最终的样本表征不是用深度网络层直接拿出一层隐层,而是用随机变量z去抽样,使随机变量z的空间分布模拟这个隐层分布。这样,VAE的encoder隐层就赋予了Z空间分布的表征意义。但是VAE的表征意义仅仅是针对单个样本的,z没有包含高层语义(比如我要控制生成“微笑的”明星),另外VAE模型本身也难以优化。

知道了GAN和VAE的缺陷,再来了解基于流的生成模型(Glow,RealNVP和NICE)就更自然。

基于流的生成模型两大卖点是:

David 9

Latest posts by David 9 (see all)

- 修订特征已经变得切实可行, “特征矫正工程”是否会成为潮流? - 27 3 月, 2024

- 量子计算系列#2 : 量子机器学习与量子深度学习补充资料,QML,QeML,QaML - 29 2 月, 2024

- “现象意识”#2:用白盒的视角研究意识和大脑,会是什么景象?微意识,主体感,超心智,意识中层理论 - 16 2 月, 2024

我想问一下作者,如何更新可逆转换函数f呢,从代码上来看,可逆函数f是随机初始化的,模型根据极大似然来更新f,具体过程是怎样的?

具体代码我也是草草过了一下,在optim.py文件中作者定义了一些最优化方式(包括EMA,adam)做更新,可以仔细看看