注意力机制看似对符号化学习(或人类智能的产生)是“隔靴瘙痒”,但从另一面说,也可能是一个基石 — David 9

熟悉David读者知道我对真正的智能(或类人智能)的产生感兴趣,当今,普遍的共识是截然相反的两种路径(方式):

1. 自上而下。构造一个本身在语义和逻辑上就有意义的系统,在这个系统下构建各个组件,随着组件的趋于完备(完美),也就达到了类人等级的智能。

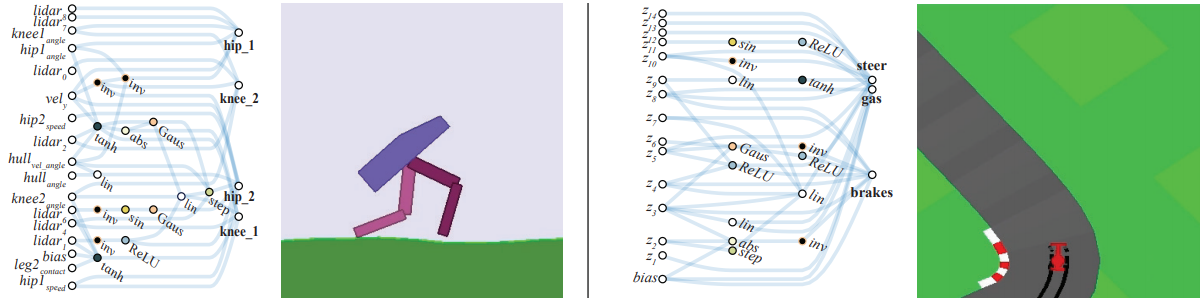

2. 自下而上。先从混沌的初级结构开始构建(类似神经网络的一层网络),慢慢构建复杂的结构,在上层慢慢“长”出意识(或智能)。

由于目前神经网络(深度网络)的浪潮,后一种声音占了多数。

但显然,David可以想象出神经网络风光不再的场景,比如到了某个阶段,人类矩阵算力(GPU)不再昂贵, 组合各种神经网络变得非常简单,同时人们又想要更多有意义的结果,那时,“拼装组合”成了主旋律,人们对神经网络内部结构已经不感兴趣。也可能,那时的神经网络已经可以自动“生长”,无需人去构建。就像我们以前在“谷歌的免训练网络”中谈到的:

回到GPT3, David其实不赞同一些网友总结GPT3的意义。

是因为1750亿参数并使用了45TB数据吗?我相信以后还会有更多更大的网络出现。

是因为用更少的领域数据,解决对领域内有标签数据的过分依赖吗?论文在相关工作中指出,元学习(Metalearning)和迁移学习都在这个方向上曾作出过努力。

仅仅因为用了较大网络达到较好(无监督)效果,就值得GPT3骄傲吗?我觉得也不是。

请读者细品一下论文的大标题:“Language Models are Few-Shot Learners”

这告诉我们OpenAI团队的两点洞见: 继续阅读GPT3无疑是一个进步,但很多人抓错了重点:对伪常识,伪逻辑和因果推理未来的一些思考