我们对信息过滤的本质知之甚少 — David 9

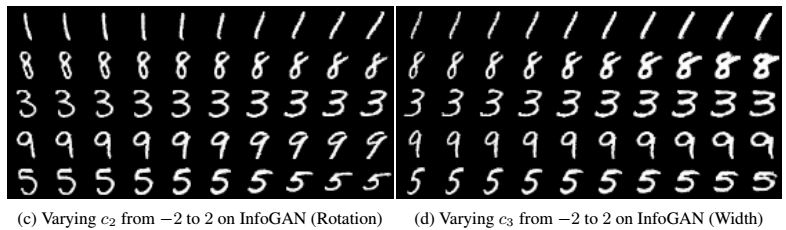

还记得我们在GAN大盘点中聊到的infoGAN吗?通过控制隐信息c可以生成特定条件的图像(倾斜更高,宽度更大):

今年Facebook在NIPS2017上发表的Fader Networks(渐变网络)更近一步,对于更抽象的特征也可以进行条件生成:

如上图,“年轻”,“苍老”,“男性”,“女性”,“是否戴墨镜”,都是可以在生成器生成阶段任意指定。

但是有没有注意到上图demo中,头发的样子始终是不变的,看来Facebook还没有很好地解决头发生成的问题?男性和女性的头发样式明显应该不同,年轻和年老时的头发样式和色泽肯定也是不同的。 继续阅读Facebook渐变神经网络: 通过任意指定属性,操纵生成图像,NIPS2017论文选读1