Neurons that fire together wire together — Donald O. Hebb

小时候你们应该听大人说过:“脑子不用会生锈”,教导我们要多思考多练习。后来我们真的发现需要肌肉记忆的运动如篮球、高尔夫,所谓的“球感”,正应验了赫布理论那句老话:“Neurons that fire together wire together”。我们的那些神经元似乎越是频繁地连接,越是有“存在感”。甚至在训练足够多的次数后,神经元的连接如此强烈,以至于产生了条件反射。

另一方面我们的神经元可以训练并适应不同的任务,其可塑性惊人。当今所谓的神经网络不过皮毛。

今天聊的脉冲神经网络(SNN),只是弥补了神经网络中的一处不足。我们在之前的post提到过Hinton老爷子对未来神经网络的展望,其中一个重点就是目前神经网络的时间线(尺度)太少了 。

开始之前,先简单回顾一下神经网络的发展。

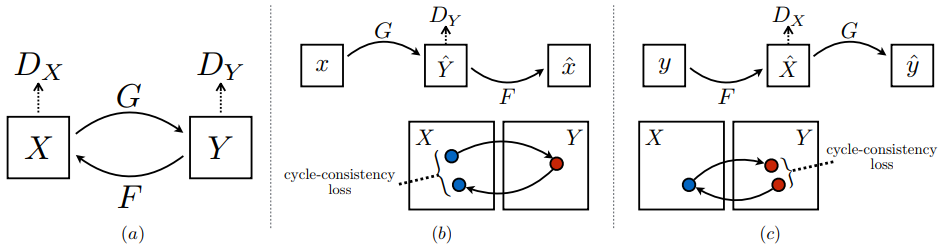

感知机(perceptron),是神经元间的直连感知:

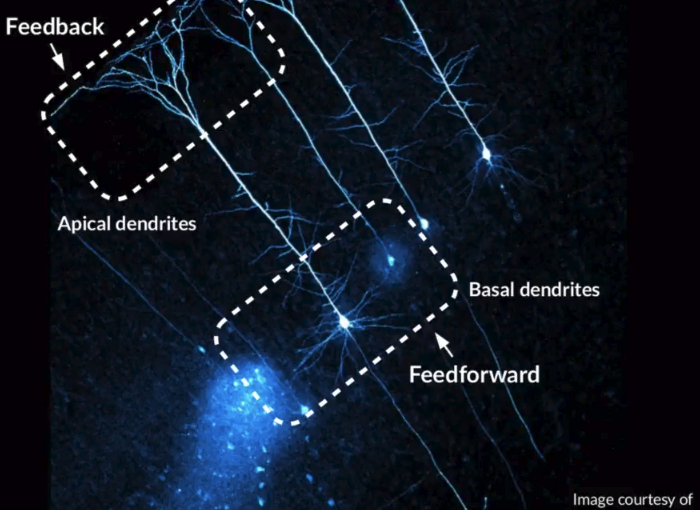

其中白色较亮的点是被激活(更兴奋)的神经元。

对于多层感知机,只是层数变多了,依旧是直连加反向传播:

轮到现在流行的CNN, 只是比感知机多了卷积层:

到目前为止可以发现,所有连接权重的更新速度是一样的。即所有神经元的连接,在某个时间点的兴奋度低,但在下一个时间点的兴奋度可能很高!(因为反向传播才不管这么多),细想,不符合那句老话:“Neurons that fire together wire together”。此刻兴奋的神经元在下一时刻应该惯性地也比较兴奋才对。 继续阅读脉冲神经网络(SNN)会是下一代神经网络吗? 知识梳理和源码解析,David 9的SNN初体验,Spiking Neural Network