想要释放模型的威力,可以尝试解放其输入的自由度,要知道,婴儿对外界各种形式信息从来都是来着不拒 — David 9

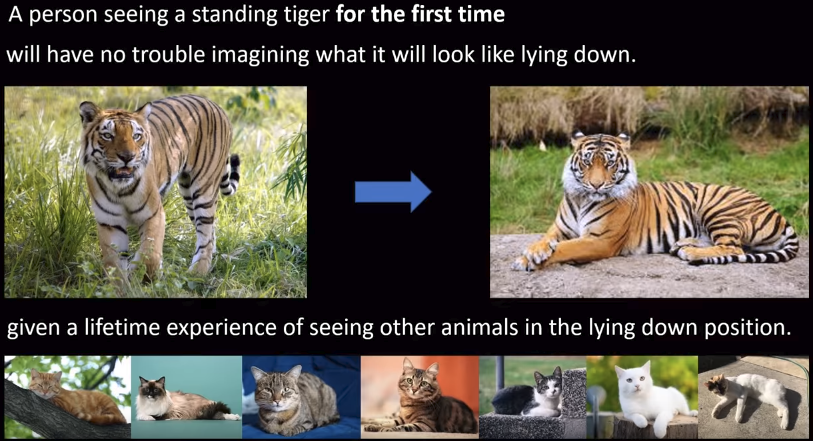

如果你没看到过老虎坐着的样子,但是你看到过其他小动物坐着的样子,你很自然地联想到老虎坐着应该是什么样子(如上封面图片所示)。

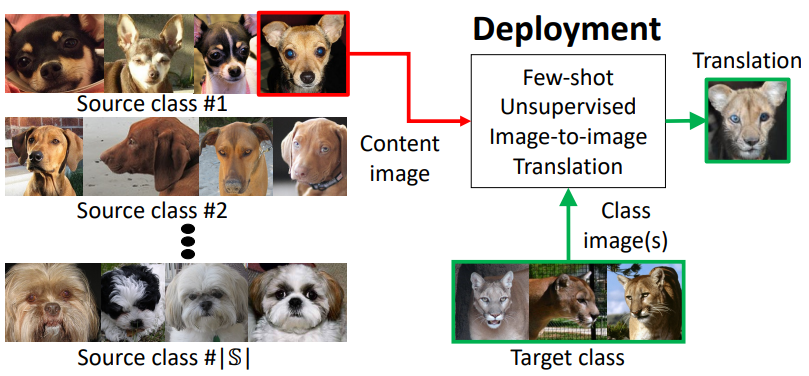

然而要让模型跨类转换图像,就没有那么容易,英伟达&&康奈尔大学使用的FUNIT模型的图像生成任务如下:

随意抽取一张原内容图片(Content image), 同时给出你想要转换到的目标类别(Target class),最后,需要由模型把原图片转换成目标类别的独特属性。如果你有一张小狗的图片,模型可以为你联想这只小狗“进化”成狮子会是什么样? 继续阅读更自由的GAN图像联想:无监督跨类的图像转换模型FUNIT,英伟达&&康奈尔大学